「この画像は本物だろうか」

「この記事は信頼できる情報か」

生成AI技術が急速に進化し、私たちの日常やビジネスシーンに浸透する中で、コンテンツの真偽を見分けるスキルがかつてなく重要になっています。AIが生成したとは気づかないほど精巧な画像や文章が、フェイクニュースや著作権侵害といった問題を引き起こすケースも少なくありません。ビジネスの現場では、誤った情報に基づいて意思決定を下したり、気づかぬうちに企業の信頼を損ねたりするリスクも潜んでいます。

この記事では、画像、文章、動画それぞれについて、生成AIコンテンツを見分けるための具体的なチェックポイントを専門家の視点で徹底解説します。さらに、最新の判定ツールや、企業として取るべきリスク対策まで網羅的にご紹介。AIの進化と正しく向き合い、ビジネスの信頼性を守るための知識を身につけましょう。AIの基礎から実践的な活用法までを網羅した「AX CAMP」の資料も、情報リテラシー向上の一助としてぜひ参考にしてみてください。

生成AIコンテンツの現状と見分ける重要性

結論として、生成AIコンテンツの真偽を見分ける能力は、現代のビジネスにおける必須のリスク管理スキルです。技術の進歩により、AIが生成する画像や文章は人間が作成したものと区別がつきにくくなっており、これが新たな社会的・ビジネス的リスクを生み出しているためです。

特に深刻なのが、フェイクニュースや偽情報の拡散です。悪意を持って作成された偽の画像やニュース記事がSNSなどを通じて瞬時に広まり、世論操作や企業の評判低下に繋がる事例が後を絶ちません。一度拡散された誤情報を訂正することは極めて困難であり、ビジネスにおける信頼性を根底から揺るがしかねない脅威と言えます。

また、法的なリスクも見過ごせません。AIが学習データとして著作権で保護されたコンテンツを無断で使用した場合、生成されたコンテンツが著作権や肖像権を侵害する可能性があります。自社のマーケティング活動などで、そうとは知らずに権利侵害コンテンツを使用してしまえば、損害賠償請求などの法的トラブルに発展するリスクが潜んでいます。

これを防ぐには、生成物に第三者の著作権・肖像権が含まれるか判断するため、

- 原素材の出所確認

- ライセンスの有無

- モデルやデータセットの利用規約確認

- (必要に応じて)権利者からの明示的許諾を得る

などを、社内利用ルール(チェックリスト/法務による承認フロー)を明記すると安全です。

こうした状況は、クリエイターの権利保護という観点からも重要です。AIに自身の作風を模倣されたり、作品を無断で学習データとして利用されたりすることへの懸念が広がっており、コンテンツの出所を明確にすることは、クリエイティブ産業の健全な発展を守るためにも必要不可欠です。企業が発信する情報や使用するコンテンツの信頼性を担保し、様々なリスクから身を守るために、生成AIを見分ける知識と体制の構築が急務となっています。

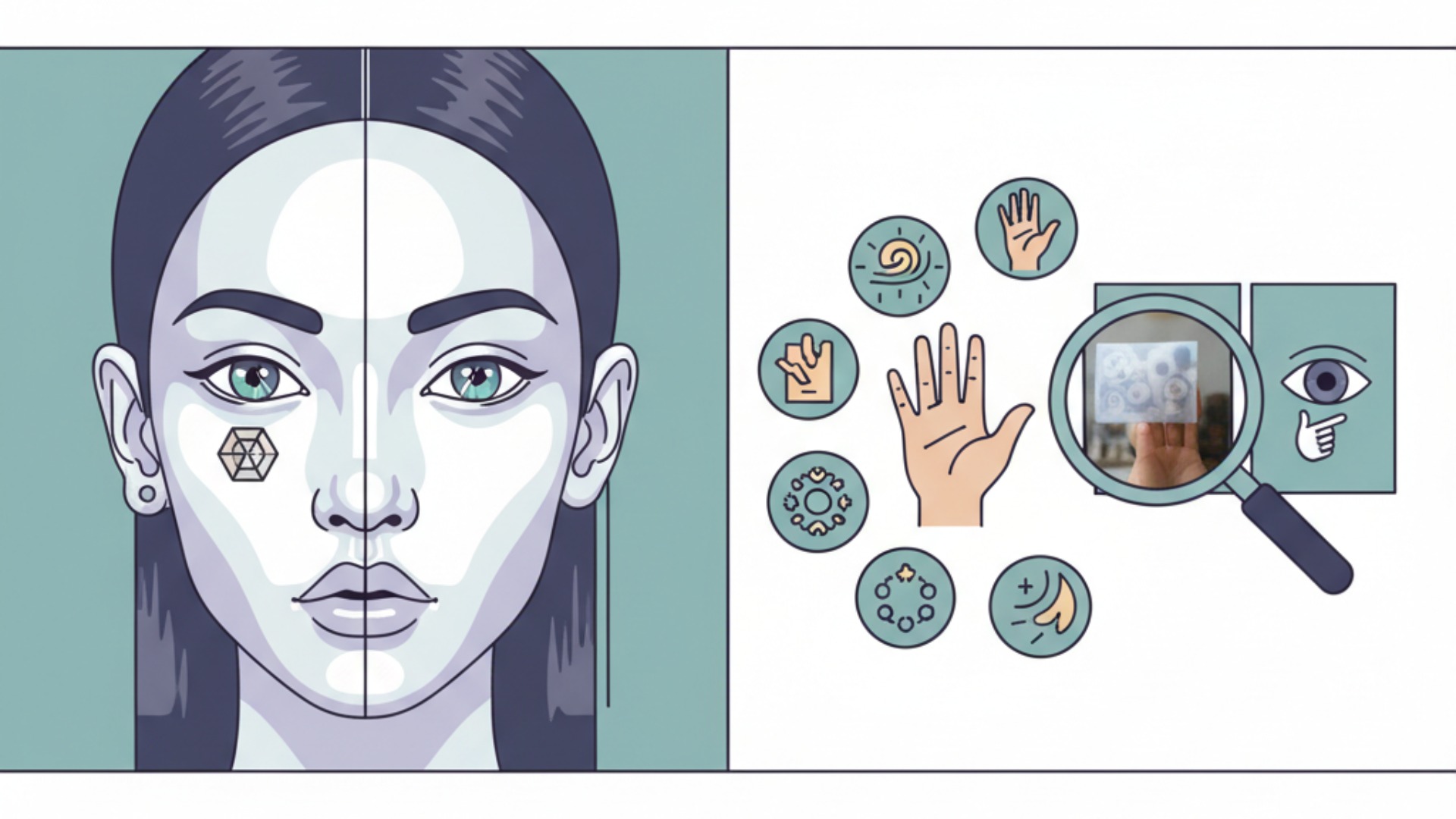

【画像編】生成AIイラスト・写真の見分け方7つのポイント

AIによって生成された画像は、一見すると非常にリアルですが、細部に不自然な点や物理的な矛盾が残っていることが多くあります。特に、人体の構造や光の当たり方など、複雑な要素が絡む部分にAIの限界が現れやすいため、注意深く観察することが見分けるための鍵となります。以下に、AI生成画像に共通して見られる7つの具体的なチェックポイントを解説します。

1. 手や指の不自然さ(指の数や形状)

AI画像を見分ける上で有名なポイントの一つが「手・指」の描写です。過去のモデルでは指が6本以上あったり、逆に少なかったりするケースが頻繁に見られました。2025年現在、トップクラスの画像生成モデルではこの問題の発生頻度は低下していますが、依然として合成ミスや複雑なポーズでの誤りが起きるため注視が必要です。(出典:AIで描かれたイラストの手が不自然なのはなぜなのか?)

2. 瞳の光や左右非対称性

人物の「瞳」も重要なチェックポイントです。左右の瞳の形や大きさが微妙に異なっていたり、瞳に映り込む光(キャッチライト)が左右で不揃いだったりする場合があります。例えば、片方の目には窓の光が映っているのに、もう片方には全く違う形の光が映っているなど、光源の矛盾が見られる場合はAI生成の可能性が高いと言えるでしょう。

3. 髪の毛の質感と流れの違和感

髪の毛一本一本の細かな流れや質感を再現することは、現在のAIにとっても難易度の高い作業です。そのため、生成された画像の髪は、まるでヘルメットのようにのっぺりとした塊に見えたり、数本が束になって不自然に肌に溶け込んでいたりする特徴があります。髪の毛の生え際や毛先の描写が曖昧な場合も注意深く確認しましょう。

4. 背景や文字の歪み・崩壊

主要な被写体だけでなく、その「背景」にも注目してください。背景にある直線(建物の柱や窓枠など)が不自然に歪んでいたり、遠近感が狂っていたりすることがあります。また、画像内に看板や本の表紙などがある場合、そこに書かれている文字が意味をなさない記号の羅列になっていたり、綴りが崩壊していたりするのも、AI生成画像によく見られる特徴です。

5. アクセサリーや衣服の破綻

人物が身につけているピアスやネックレス、メガネといったアクセサリーもヒントになります。左右のイヤリングのデザインが非対称であったり、ネックレスのチェーンが途中で消えていたり、メガネのフレームが物理的にありえない構造をしていたりするなど、細部に矛盾点が見つかることがあります。衣服の柄や縫い目が途中で不自然に途切れているケースも同様です。

6. 光と影の物理的な矛盾

現実世界の物体は、光源に対して一貫した影を落とします。しかし、AI生成画像では、この物理法則が無視されることがあります。例えば、被写体の右側から光が当たっているように見えるのに、影は左側だけでなく複数の方向に出ているなど、光と影の関係性に矛盾がある場合は、AIによる生成を疑うべきサインです。

7. 過度に滑らかな肌やテクスチャ

AIは、人物の肌を過度に滑らかで完璧なものとして描写する傾向があります。毛穴やシミ、細かなシワといった、人間本来の肌が持つべき質感が完全に欠落している場合、AIによる画像加工や生成の可能性があります。これは肌だけでなく、布や金属、木材などのテクスチャにおいても同様で、あまりに均一で「綺麗すぎる」質感は不自然さの現れと言えます。

【文章編】生成AIが書いたテキストを見抜く5つの視点

生成AIが作成した文章は、文法的に正しく流暢であることが多い反面、内容の正確性や表現の具体性に課題を抱えています。一見すると人間が書いたような自然な文章でも、いくつかの視点から注意深く読むことで、AI特有のクセや限界を見抜くことが可能です。ここでは、AIが生成したテキストに共通して見られる5つの特徴的な視点について解説します。

1. 事実関係の誤りや情報の不整合

生成AIは、学習データに基づいて確率的にもっともらしい単語を繋げて文章を生成するため、事実に基づかない情報を断定的に記述してしまう「ハルシネーション(幻覚)」を起こすことがあります。存在しない事件や統計データ、人物の発言などを、あたかも事実であるかのように記述するのは典型的な例です。文章内で前半と後半の主張が矛盾しているなど、情報の不整合が見られる場合も注意が必要です。特に医療・健康分野など、情報の正確性が人命に関わる領域では、医療に関する情報は専門家の助言を代替するものではないと明示し、専門家による監修を徹底すべきです。

2. 感情や具体性の欠如した表現

AIには人間のような実体験や感情がないため、その文章は客観的で無機質なトーンになりがちです。個人的な体験談や具体的なエピソード、感情のこもった表現が少なく、どこか他人事のような書き方をしているのが特徴です。例えば、商品のレビュー記事なのに「素晴らしい製品です」といった抽象的な賞賛に終始し、「実際に使ってみて、どんな点がどう良かったのか」という具体性に欠ける場合は、AIによる生成が疑われます。

3. 過度に一般的・抽象的な言い回し

生成AIは、当たり障りのない一般的な表現や、誰にでも当てはまるような抽象的な言い回しを多用する傾向があります。これは、特定の立場に偏らない、平均的で無難な回答を生成するように設計されているためです。「〜は重要です」「多くの可能性があります」「様々な要因が考えられます」といった表現が頻出する文章は、具体的に何も語っていないことが多く、AIらしさのサインと言えるでしょう。

4. 不自然な繰り返しや定型文の多用

文章全体を通して、同じ単語やフレーズ、あるいは同じ構造の文章が不自然に繰り返されることがあります。例えば、「さらに、〜です。加えて、〜です。それだけでなく、〜です。」のように、接続詞のバリエーションが乏しかったり、特定のキーワードを過剰に詰め込んだりする傾向が見られます。これは、AIが文脈の多様性を十分に理解せず、特定のパターンに固執してしまうために起こります。

5. 文脈に合わない専門用語の使用

一見すると専門性が高そうな文章に見えても、よく読むと専門用語の使い方が不正確だったり、文脈にそぐわない場面で唐突に使用されたりすることがあります。AIは単語とその定義を学習していますが、その用語が実際にどのようなニュアンスや文脈で使われるかまでは深く理解していない場合があります。専門家が見ればすぐに違和感を覚えるような用語の使い方は、AIが生成した文章である可能性を示唆しています。

【動画・音声編】ディープフェイクを見破るためのチェック項目

ディープフェイク技術の進化により、本物と見分けがつかないほど精巧な偽の動画や音声が作成可能になりました。著名人や政治家になりすまして偽情報を発信したり、詐欺に悪用されたりするケースも報告されており、その脅威は増すばかりです。しかし、どれだけ巧妙なディープフェイクでも、多くの場合、細部に不自然な痕跡が残されています。ここでは、ディープフェイクの動画や音声を見破るための具体的なチェック項目を解説します。

瞬きの頻度や動きの不自然さ

人間は無意識に一定の頻度で瞬きをしますが、初期のディープフェイク動画では、この瞬きの回数が極端に少ない、あるいは全くしないという特徴がありました。最近の技術では改善されつつありますが、依然として瞬きのタイミングが不自然だったり、まぶたの動きが滑らかでなかったりする場合があります。

口の動きと音声のズレ(リップシンク)

話している内容と口の動きが完全に一致しているか(リップシンク)は、非常に重要なチェックポイントです。ディープフェイクでは、音声と映像を別々に生成して後から合成することが多いため、口の動きと音声が微妙にずれることがあります。特に、「ぱ」「ま」行のような唇を閉じる発音の際に、不自然な動きが見られやすいです。

顔の輪郭や肌の質感のノイズ

動画の中で人物が顔を速く動かしたり、横を向いたりした際に、顔の輪郭部分が不自然にぼやけたり、背景に溶け込むようなノイズが発生したりすることがあります。これは、元の映像に別の顔を合成しているため、境界部分の処理が追いつかないために起こります。また、顔の部分だけ肌の質感がのっぺりとしていて、首や手など他の部分と質感や色合いが異なる場合も注意が必要です。

声のトーンや感情表現の単調さ

音声のディープフェイクでは、声色自体は本人に似せることができても、感情の起伏やイントネーションの再現が不十分な場合があります。話している内容が感情的なものであるにもかかわらず、声のトーンが終始一定で抑揚がない、あるいはロボットのように単調に聞こえる場合は、AIによって生成された音声である可能性が高いです。不自然な間や、単語の途切れなども判断材料になります。

背景の不自然な揺れや変化

人物の動きに注目が集まりがちですが、背景の様子も確認しましょう。ディープフェイクの処理過程で、人物の周囲にある背景が不自然に歪んだり、揺れたりすることがあります。また、映像全体はクリアなのに、人物の肩や髪の毛の周りだけが不鮮明になっているなど、映像品質にムラがある場合も合成を疑うべきサインです。

映像全体の解像度と部分的な不鮮明さ

ディープフェイク動画は、多くの場合、高解像度の元映像を必要とします。そのため、動画全体の解像度が不自然に低い場合や、逆に顔の部分だけが他の部分に比べて異常に鮮明であるなど、解像度の不一致が見られる場合は注意が必要です。これは、異なる品質の映像素材を組み合わせて作られている可能性を示唆しています。

生成AIコンテンツを判定するおすすめツール10選【2026年】

目視によるチェックだけでは判断が難しい巧妙な生成AIコンテンツも増えています。そのような場合には、専用の判定ツールを活用することが非常に有効です。これらのツールは、人間では気づきにくいデータ上の特徴を分析し、AIによって生成された可能性を数値で示してくれます。ただし、外部ツールに自社の機密情報や個人情報を含むデータをアップロードすることは情報漏洩に繋がるため、社内ポリシーで禁止するか、匿名化処理を徹底する必要があります。

これらのツールはそれぞれ得意分野が異なるため、判定したいコンテンツの種類に応じて使い分けることが重要です。多くは無料で試せますが、高精度な分析や大量処理には有料プランが必要な場合があります。ツールの対応状況は変化する可能性があるため、利用前に各ベンダーの最新情報と利用規約を必ず確認してください。

| ツール名 | 判定対象 | 特徴 |

|---|---|---|

| AI or Not | 画像 | シンプルで使いやすいUIが特徴。画像をアップロードするだけで、AI生成かどうかを即座に判定してくれる。 |

| Fake Image Detector | 画像 | 画像のメタデータやエラーレベル分析(ELA)など、複数の技術を用いて偽造やAI生成の可能性を検出する。 |

| Hive Moderation | 画像・動画・テキスト | AI生成コンテンツの検出だけでなく、不適切なコンテンツのフィルタリングなど、総合的なモデレーション機能を提供。API連携も可能。 |

| GPTZero | 文章 | 文章の複雑さや表現のばらつきを分析しAIらしさを判定。新しいモデルへの対応状況は変動するため、利用前に公式サイトでの確認が推奨される。 |

| Copyleaks | 文章 | AIコンテンツ検出と同時に、ウェブ上のコンテンツとの類似性をチェックする剽窃検知機能も搭載。多言語に対応している点が強み。 |

| Sensity | ディープフェイク | ディープフェイク動画・画像の検出に特化したプラットフォーム。企業のブランド保護や偽情報対策として導入されている。 |

| Deepware Scanner (Deepware.ai) | ディープフェイク | ベータ版として提供されている商用のDeepfake検出サービス。WebサイトまたはAPI経由で利用でき、動画ファイルをスキャンできる。 |

| Resemble AI | 音声 | AI音声の生成だけでなく、アップロードされた音声がAIによって生成されたものか(ディープフェイク音声か)を検出する機能も提供。 |

生成AIコンテンツを見分けられないリスクと企業が取るべき対策

生成AIコンテンツを安易に信頼し、見分けられないまま事業活動に利用してしまうことは、企業にとって多岐にわたる深刻なリスクをもたらします。ブランドイメージの毀損から法的なトラブルまで、その影響は計り知れません。これらのリスクを回避するためには、個人のスキルだけに頼るのではなく、組織全体として体系的な対策を講じることが不可欠です。

企業が直面する主なリスクとしては、まず「ブランドイメージの毀損」が挙げられます。自社サイトやSNSで誤った情報や不適切なAI生成コンテンツを発信してしまえば、顧客や社会からの信頼を失うことになります。また、サイバーセキュリティ上の脅威も深刻です。ディープフェイク技術を悪用した「ビジネスメール詐欺(BEC)」や、役員になりすました偽の指示による不正送金など、新たな手口の攻撃に晒される危険性が高まっています。

さらに、著作権や肖像権を侵害するAI生成コンテンツを無断で使用した場合、損害賠償請求を受けるなどの「法務・コンプライアンス違反」に問われる可能性もあります。こうした複合的なリスクから企業を守るためには、以下の3つの対策を柱として推進することが重要です。

従業員向けリテラシー教育の実施

まず基本となるのが、全従業員を対象としたリテラシー教育です。生成AIの仕組みや潜在的なリスク、そして本記事で解説したような具体的な見分け方について、体系的に学ぶ機会を提供することが求められます。定期的な研修を通じて、従業員一人ひとりの情報識別能力を高めることが、組織全体の防御力を向上させる第一歩となります。

コンテンツの真贋チェック体制の構築

外部に公開するコンテンツや、業務で利用する情報については、その真贋をチェックする明確なフローを構築する必要があります。特に重要な情報や公式発表に関しては、複数の担当者によるダブルチェックや、前述した判定ツールの利用を義務付けるなど、属人的な判断に依存しない客観的な検証プロセスを整備することが不可欠です。

電子透かし(ウォーターマーク)技術の活用

自社が発信する正規のコンテンツを守るための対策も重要です。C2PA(Coalition for Content Provenance and Authenticity)のような標準規格に準拠した電子透かし(デジタルウォーターマーク)技術を活用することで、コンテンツの出所や作成履歴を証明できます。これにより、自社のコンテンツが悪意を持って改ざんされたり、なりすましに利用されたりするのを防ぎ、受け手が情報の真贋を容易に確認できるようになります。

法人向けAI活用ならAX CAMPの研修がおすすめ

生成AIコンテンツを見分けるスキルは重要ですが、ビジネスを前進させるためには、リスクを回避する「守り」の知識だけでなく、AIを戦略的に活用する「攻め」の実践力が不可欠です。しかし、「何から学べば良いかわからない」「自社の業務にどう活かせるのかイメージが湧かない」といった課題を抱える企業様は少なくありません。

そのような課題を解決するのが、当社が提供する法人向けAI研修サービス「AX CAMP」です。AX CAMPは、単なる知識のインプットに留まらず、貴社の実務課題に直結する実践的なスキル習得を目的としています。最新のAIトレンドやリスク管理手法はもちろんのこと、実際の業務データを活用したワークショップを通じて、明日から使える具体的なAI活用法を身につけることができます。実際に導入企業様からは、以下のような成果報告が寄せられています。(出典:AX実績インタビュー)

- LP制作:外注費月10万円が0円に。制作時間も3営業日から2時間へ短縮

- 記事執筆:24時間かかっていた作業がわずか10秒で完了

- SNS運用:業務時間を1日3時間から1時間に短縮し、月間1,000万impを達成

AX CAMPの特長は、経験豊富なプロフェッショナルによる伴走支援体制にあります。研修中はもちろん、研修後も継続的なサポートを提供し、貴社が自律的にAI活用を推進できる組織となるまで徹底的にご支援します。

AI時代に必須となる情報リテラシーの向上から、全社的な生産性向上、さらには新規事業の創出まで、AIに関するあらゆるニーズにお応えします。AIを正しく理解し、ビジネスの強力な武器とするための第一歩を踏み出しませんか。ご興味をお持ちいただけましたら、まずはお気軽に無料相談会へご参加ください。

まとめ:生成AIの見分け方をマスターし、正しく情報を活用しよう

本記事では、急速に普及する生成AIコンテンツを正確に見分けるための具体的な方法と、企業が取るべき対策について詳しく解説しました。AI技術の進化は私たちのビジネスに大きな可能性をもたらす一方で、新たなリスクも生み出しています。情報の真偽を正しく見極め、適切に対応する能力は、これからのビジネスパーソンにとって必須のスキルと言えるでしょう。

この記事の重要なポイントを以下にまとめます。

- 画像の見分け方:手指や瞳の不自然さ、背景の歪み、光と影の矛盾など、細部に注目することが重要です。

- 文章の見分け方:事実関係の誤り、具体性の欠如、不自然な繰り返しといった、AI特有の文章のクセを見抜きます。

- 動画・音声の見分け方:瞬きの頻度や口の動きのズレ、声のトーンの単調さなどがディープフェイクを判断する手がかりとなります。

- ツールの活用:目視での判断が難しい場合は、専用の判定ツールを補助的に利用することが効果的です。

- 企業としての対策:従業員へのリテラシー教育、コンテンツのチェック体制構築、電子透かし技術の活用などを組織的に進める必要があります。

これらの見分け方を習得し、リスク対策を講じることは、自社を偽情報や法的トラブルから守るために不可欠です。そして、その先には、AIを安全かつ効果的に活用し、業務効率化や新たな価値創造を実現する道が拓けます。「AX CAMP」では、AIのリスク管理から実践的な活用スキルまで、貴社の状況に合わせてカスタマイズした研修プログラムを提供しています。専門家の支援を受けながら、AI時代を勝ち抜くための確かな実力を身につけることができます。AIの導入や人材育成に関するお悩みがあれば、ぜひ一度、当社の無料相談をご活用ください。